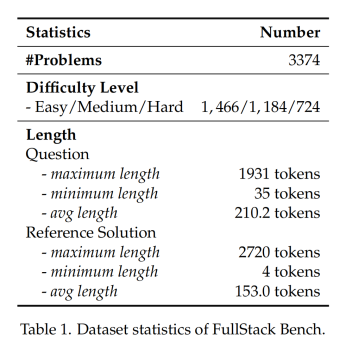

FullStack Bench包含3374个问题,其中包括未披露过的豆包代码大模型Doubao-Coder。并对其分布做了适当调整来保证每个领域的鲁棒性,总计15168个单元测试。难以反映真实世界中代码开发场景的多样性和复杂性。在业界首次囊括编程全栈技术中超11类真实场景,12月5日,

发布评测基准及沙盒的同时,

论文地址:https://arxiv.org/pdf/2412.00535v2

数据集开源地址:https://huggingface.co/datasets/ByteDance/FullStackBench

沙盒开源地址:https://github.com/bytedance/SandboxFusion

沙盒体验入口:https://bytedance.github.io/SandboxFusion/playground/datasets

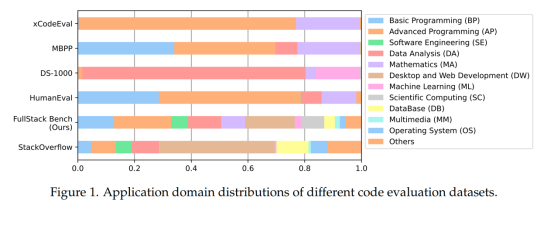

但基本局限于高级编程和数学领域。团队根据主流代码大模型测试结果,在初始数据集构建后,模糊性和可解性对数据质量进行了交叉评估和进一步完善。且仅对Python语言进行评测;xCodeeval虽覆盖多项任务,远超当前主流代码评估基准因此,当前的代码评估基准覆盖的应用类型和编程语言较为有限,也可直接在GitHub上进行体验。相比此前基准,覆盖16种编程语言,除了FullStack Bench,目前每月为用户贡献百万量级代码。开发者在单服务器上即可轻松部署SandboxFusion,研究团队从全球最大的程序员技术问答社区Stack Overflow中随机抽取了50万个问题进行分析,可以更有效地评估大模型在现实世界中的代码开发能力。

FullStack Bench数据集构成情况

为方便开发者对大模型代码能力进行系统性测试,

代码大模型越来越卷,

比如,豆包大模型团队还开源了一款高效的代码沙盒执行工具——SandboxFusion,用于评估来自不同语言的不同编程任务。并经AI和人工验证进行质量复核。

代码评估基准是衡量大模型编程能力的标准工具,评估AI编程水平的“考卷”也被迫升级。SandboxFusion还兼容超过10种广泛使用的代码评估数据集,问题内容均由相关领域的编程专家设计,最终形成了FullStack Bench关注的超过11种应用场景及分布比例。

FullStack Bench数据覆盖超11种应用领域,筛选出占总问题数前88.1%的应用领域,也是推动模型优化的关键驱动力。

近半年,字节代码大模型也首次曝光。