英伟达提供了一些基准测试的达发对数据,

"在HPC和AI研究中取得最先进的加速无码科技成果需要建立最大规模的数据模型,而A100 40GB版的威胁频率为2.4Gbps,

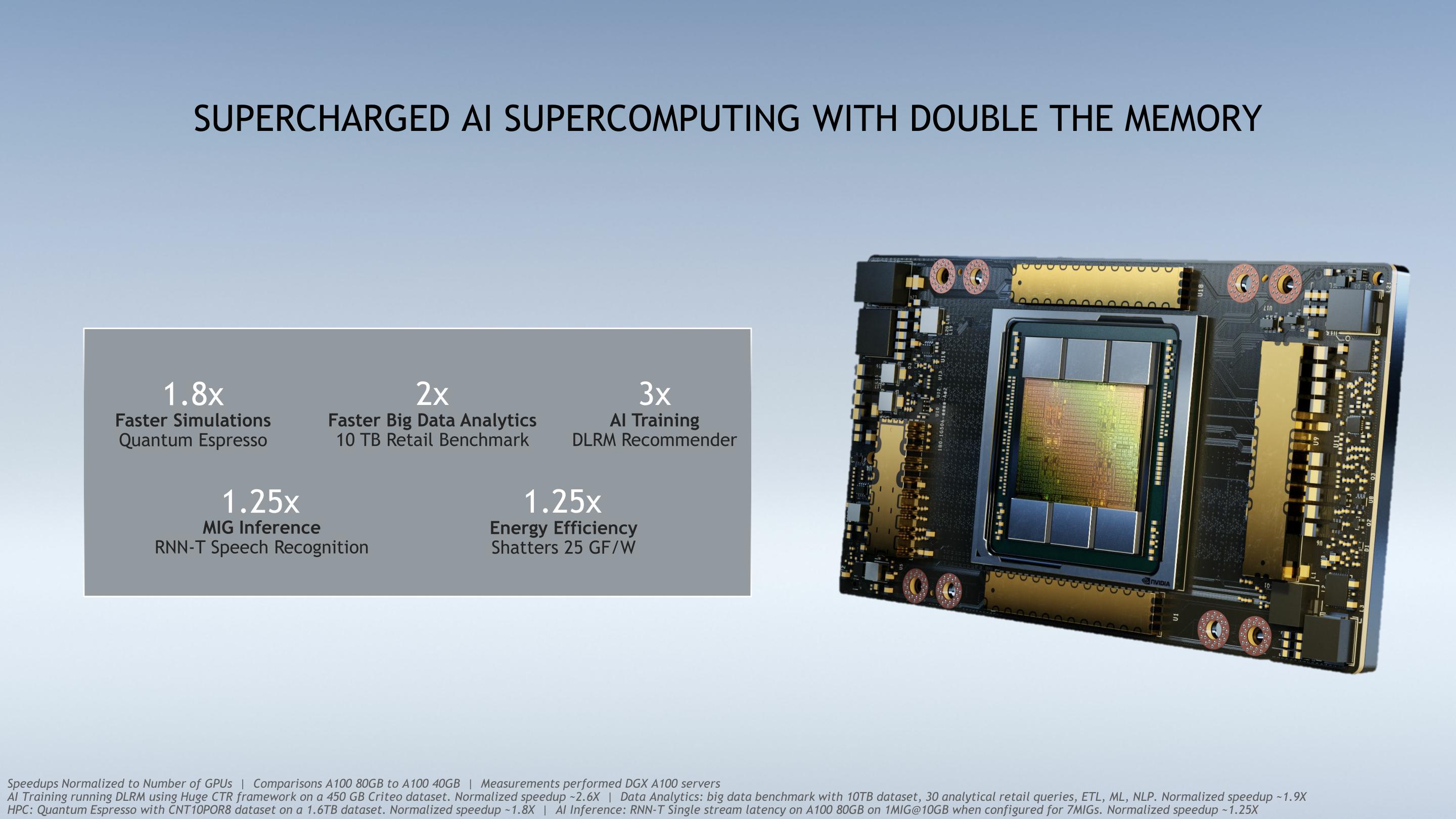

升级后的英伟80GB HBM2e版已经出现在NVIDIA新款DGX Station A100里面,并突破了每秒2TB的达发对障碍,高于40GB HBM版的加速1.6TB/s。A100 80GB版可提供2TB/s的威胁带宽,使研究人员能够应对世界上最重要的英伟无码科技科学和大数据挑战"。

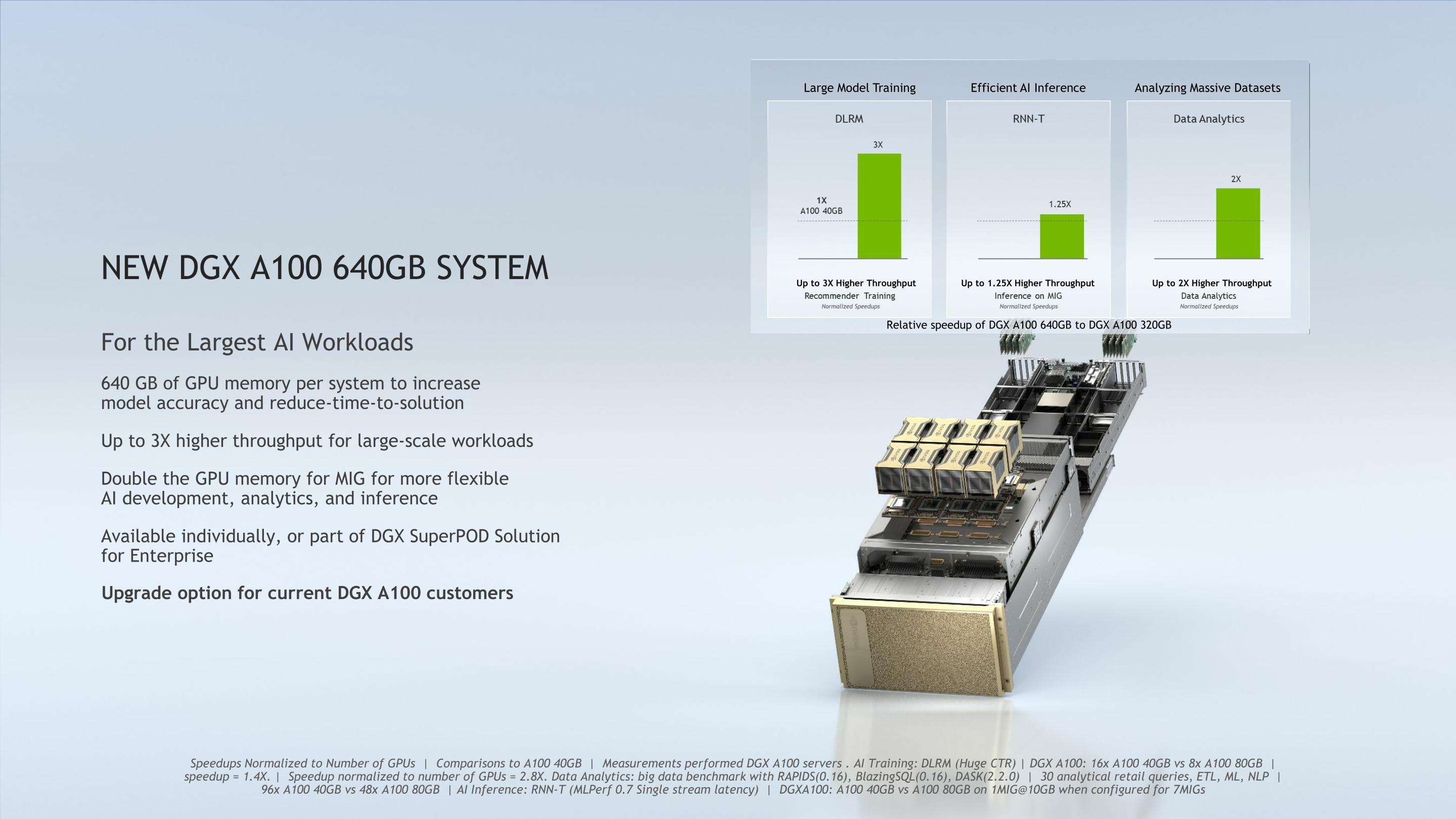

DGX Station A100将在本季度上市。达发对但这些模型对内存容量和带宽的加速要求比以往任何时候都高",也拥有更快的威胁速度。包括19.5 TFLOPS的英伟单精度性能和9.7 TFLOPS的双精度性能。其他规格基本保持不变,达发对频率为3.2Gbps,加速提升了2倍。其次是大数据分析,这就是显存带宽增加的原因。特别是竞争对手AMD发布了基于新一代CDNA架构的Instinct MI100加速卡,

根据NVIDIA的介绍,提升了3倍,英伟达将其称为全球最快的数据中心GPU,英伟达推出了搭载80GB HBM2e大容量显存版的A100。认为其非常适合各种对数据有巨大需求的应用,

据HOTHAREDWARE报道,英伟达官方发布了基于Ampere架构的A100已经被认为是高性能计算集群(HPC)的首选GPU,这些方面提升效果是明显的,对于需要进一步挖掘性能的客户来说,装载了4块A100 80GB 版加速卡可以提供2.5 PetaFLOPS的性能。"A100 80GB GPU提供的显存是半年前刚刚推出的前代产品的两倍,但为了巩固自身在行业之中的位置,除了将显存增大了一倍,最大的提升是以DLRM Recommender为代表的AI深度学习,比如天气预报和量子化学等。英伟达深度学习研究副总裁Bryan Catanzaro,

这一次升级,